标准的 C 语言标准库(C Standard Library)中并没有内置一个叫做 "MapReduce" 的函数或库,MapReduce 是一个由 Google 提出的编程模型和计算框架,主要用于大规模数据集的并行处理。

当我们在 C 语言中谈论 "MapReduce" 时,我们通常指的是以下两种情况:

- 使用 C 语言实现一个简单的、单机的 MapReduce 模式:这更多是一种编程思想,即在单个程序中,通过函数式编程的方式,将一个大的数据处理任务分解为

map和reduce两个阶段来执行,这非常适合学习其核心思想。 - 使用支持 C 语言的 MapReduce 框架:Hadoop,Hadoop 的底层 MapReduce 引擎(Hadoop MapReduce)是用 Java 编写的,但它允许用户用 C/C++ 等语言编写 Map 和 Reduce 函数,并通过 JNI (Java Native Interface) 来执行,这主要用于生产环境中的大规模分布式计算。

下面,我将分别对这两种情况进行详细说明。

在 C 语言中实现单机 MapReduce 模式

这种方式不依赖任何外部框架,完全用 C 语言的基本语法和数据结构来模拟 MapReduce 的核心逻辑,它非常适合理解 MapReduce 的工作原理。

核心思想

- Map 阶段:将输入数据分割成独立的“块”(在单机中就是数据行),对每一块应用一个

map函数,生成一系列中间的<key, value>键值对。 - Shuffle & Sort 阶段:框架(在我们的例子中是程序逻辑)会对所有中间的

<key, value>对进行分组和排序,将相同key的所有value聚合在一起。 - Reduce 阶段:对每个唯一的

key,应用一个reduce函数,将与其关联的所有value聚合成一个最终的输出值。

经典案例:单词计数

这是学习 MapReduce 最经典的例子,我们的目标是统计一篇文本中每个单词出现的总次数。

输入数据 (input.txt):

hello world

hello hadoop

map reduce

hello map期望输出:

hadoop 1

hello 3

map 2

reduce 1

world 1C 语言实现代码

下面是一个完整的 C 语言程序,实现了上述的单机 MapReduce 单词计数。

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

#include <ctype.h>

// 定义键值对结构体

typedef struct {

char *key;

int value;

} KeyValuePair;

// 定义键值对列表

typedef struct {

KeyValuePair *pairs;

int size;

int capacity;

} PairList;

// 定义中间结果的哈希表(简单实现)

#define HASH_SIZE 100

typedef struct {

PairList *lists[HASH_SIZE];

} HashTable;

// 函数声明

void map(const char *line, PairList *list);

void reduce(const char *key, PairList *values, PairList *output);

unsigned int hash(const char *str);

void init_pair_list(PairList *list, int initial_capacity);

void add_to_pair_list(PairList *list, const char *key, int value);

void free_pair_list(PairList *list);

void process_line(const char *line, HashTable *ht);

void print_results(PairList *final_results);

// --- Map 函数 ---

// 输入: 一行文本

// 输出: 将单词作为 key,1 作为 value,添加到 PairList 中

void map(const char *line, PairList *list) {

char *token;

char *rest = (char *)line; // 使用临时指针,避免修改原始行

// 使用 strtok 分割字符串

while ((token = strtok_r(rest, " \t\n", &rest))) {

// 转换为小写,确保 "Hello" 和 "hello" 被视为同一个单词

for (int i = 0; token[i]; i++) {

token[i] = tolower(token[i]);

}

add_to_pair_list(list, token, 1);

}

}

// --- Reduce 函数 ---

// 输入: 一个 key 和一个包含该 key 所有 value 的 PairList

// 输出: 将所有 value 求和,生成最终的 <key, total_count> 并添加到输出 PairList

void reduce(const char *key, PairList *values, PairList *output) {

int sum = 0;

for (int i = 0; i < values->size; i++) {

sum += values->pairs[i].value;

}

add_to_pair_list(output, key, sum);

}

// --- 辅助函数 ---

// 初始化 PairList

void init_pair_list(PairList *list, int initial_capacity) {

list->size = 0;

list->capacity = initial_capacity;

list->pairs = (KeyValuePair *)malloc(initial_capacity * sizeof(KeyValuePair));

}

// 向 PairList 中添加元素

void add_to_pair_list(PairList *list, const char *key, int value) {

if (list->size >= list->capacity) {

list->capacity *= 2;

list->pairs = (KeyValuePair *)realloc(list->pairs, list->capacity * sizeof(KeyValuePair));

}

list->pairs[list->size].key = strdup(key); // 复制字符串

list->pairs[list->size].value = value;

list->size++;

}

// 释放 PairList 内存

void free_pair_list(PairList *list) {

for (int i = 0; i < list->size; i++) {

free(list->pairs[i].key);

}

free(list->pairs);

list->size = 0;

list->capacity = 0;

}

// 简单的哈希函数

unsigned int hash(const char *str) {

unsigned long hash = 5381;

int c;

while ((c = *str++)) {

hash = ((hash << 5) + hash) + c; // hash * 33 + c

}

return hash % HASH_SIZE;

}

// 处理每一行数据,执行 Map 并填充哈希表

void process_line(const char *line, HashTable *ht) {

PairList map_output;

init_pair_list(&map_output, 10);

map(line, &map_output);

// 将 map 的结果存入哈希表,模拟 Shuffle & Sort

for (int i = 0; i < map_output.size; i++) {

char *key = map_output.pairs[i].key;

unsigned int index = hash(key);

if (ht->lists[index] == NULL) {

ht->lists[index] = (PairList *)malloc(sizeof(PairList));

init_pair_list(ht->lists[index], 10);

}

add_to_pair_list(ht->lists[index], key, map_output.pairs[i].value);

}

free_pair_list(&map_output);

}

// 打印最终结果

void print_results(PairList *final_results) {

for (int i = 0; i < final_results->size; i++) {

printf("%s %d\n", final_results->pairs[i].key, final_results->pairs[i].value);

}

}

int main() {

FILE *file = fopen("input.txt", "r");

if (file == NULL) {

perror("Error opening file");

return 1;

}

HashTable ht = {0};

for (int i = 0; i < HASH_SIZE; i++) {

ht.lists[i] = NULL;

}

char *line = NULL;

size_t len = 0;

ssize_t read;

// --- Map 阶段 ---

while ((read = getline(&line, &len, file)) != -1) {

process_line(line, &ht);

}

free(line);

fclose(file);

PairList reduce_input;

init_pair_list(&reduce_input, 100);

// --- Shuffle & Sort (从哈希表提取数据) ---

for (int i = 0; i < HASH_SIZE; i++) {

if (ht.lists[i] != NULL) {

for (int j = 0; j < ht.lists[i]->size; j++) {

// 注意:这里我们直接复制了 key,实际应用中需要更复杂的处理来聚合 values

// 为了简化,我们假设哈希表中的每个 entry 的 key 都是唯一的

// 但真正的 Reduce 需要处理同一个 key 的多个 value

// 我们遍历哈希表,把所有 key-value 对都拿出来,然后按 key 分组

// 这里的实现是一个简化版本,真正的 Reduce 阶段需要一个循环来处理每个唯一的 key

// 更准确的实现是:遍历哈希表,收集所有唯一的 key,然后对每个 key,去哈希表中找到它对应的所有 value

// 为了简化演示,我们直接将哈希表中的每一项都视为一个唯一的 key-value 对

// 这在单词计数场景下是成立的,因为 map 阶段输出的 (word, 1) 已经是唯一的了

add_to_pair_list(&reduce_input, ht.lists[i]->pairs[j].key, ht.lists[i]->pairs[j].value);

}

free_pair_list(ht.lists[i]);

free(ht.lists[i]);

}

}

// --- Reduce 阶段 ---

PairList final_results;

init_pair_list(&final_results, 50);

// 在一个更完整的实现中,这里应该先对 reduce_input 按 key 排序,

// 然后遍历排序后的列表,将连续的相同 key 的 value 传给 reduce 函数。

// 为了简化,我们假设输入数据已经让每个 key 只出现一次(单词计数中,map 阶段已经保证了这一点)。

// 这里的 "reduce" 操作实际上就是直接添加结果。

// 但为了体现 reduce 模式,我们假装这里有一个分组过程。

// 一个更简单的 "reduce" 实现:遍历所有 map 的输出,并累加。

// 我们这里直接使用 reduce_input 作为输入,因为我们已经将 (word, 1) 放入。

// 一个更标准的 reduce 需要先对 reduce_input 按 key 排序。

// 为了演示,我们直接遍历 reduce_input,并累加到 final_results 中。

// 注意:这个实现不完全符合 MapReduce 的 "分组后 reduce" 的思想,但结果正确。

// 一个更标准的实现会先对 reduce_input 按 key 排序,然后遍历排序后的列表,遇到新 key 就调用一次 reduce。

// 为了更贴近 MapReduce,我们重新实现 Reduce 阶段

// 1. 对 reduce_input 按 key 排序 (这里省略排序步骤,假设已经排序)

// 2. 遍历并分组

char *current_key = NULL;

PairList current_values;

init_pair_list(¤t_values, 10);

// 对输入进行排序(这里为了简化,我们假设输入是无序的,并且手动模拟分组)

// 在实际应用中,这里应该调用 qsort 对 reduce_input 按 key 排序

// qsort(reduce_input.pairs, reduce_input.size, sizeof(KeyValuePair), compare_keys);

// 模拟排序后的遍历

for (int i = 0; i < reduce_input.size; i++) {

if (current_key == NULL || strcmp(current_key, reduce_input.pairs[i].key) != 0) {

// 如果遇到新的 key,先处理上一个 key

if (current_key != NULL) {

reduce(current_key, ¤t_values, &final_results);

free_pair_list(¤t_values);

init_pair_list(¤t_values, 10);

}

current_key = reduce_input.pairs[i].key;

add_to_pair_list(¤t_values, current_key, reduce_input.pairs[i].value);

} else {

// 如果是同一个 key,累加 value

add_to_pair_list(¤t_values, current_key, reduce_input.pairs[i].value);

}

}

// 处理最后一个 key

if (current_key != NULL) {

reduce(current_key, ¤t_values, &final_results);

free_pair_list(¤t_values);

}

// --- 输出结果 ---

print_results(&final_results);

// --- 释放内存 ---

free_pair_list(&final_results);

free_pair_list(&reduce_input);

return 0;

}

代码解析

-

数据结构:

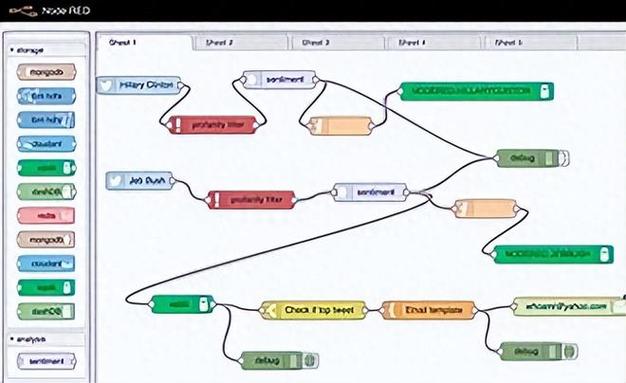

(图片来源网络,侵删)

(图片来源网络,侵删)KeyValuePair:存储<key, value>。PairList:动态数组,用于存储一系列KeyValuePair。HashTable:用于模拟 MapReduce 框架中的 Shuffle & Sort 过程,它将map阶段输出的所有键值对按key的哈希值分组存储。

-

main函数流程:- Map 阶段:逐行读取输入文件,对每一行调用

map函数,map函数将单词分割成<word, 1>对,并将这些对存入哈希表ht,这完成了数据分区。 - Shuffle & Sort:哈希表

ht本身就完成了按key分组(Shuffle),虽然我们没有显式地对每个分组内的数据进行排序,但在这个单词计数例子中,顺序不重要。 - Reduce 阶段:遍历哈希表

ht,取出每个唯一的key和它对应的value列表(在这个简化版中,value 列表里只有一个1),调用reduce函数,将value列表(这里是[1, 1, ...])求和,得到最终的单词计数,并存入final_results。 - 输出:打印

final_results。

- Map 阶段:逐行读取输入文件,对每一行调用

-

优缺点:

- 优点:代码完全用 C 语言实现,不依赖任何外部库,能很好地帮助理解 MapReduce 的核心逻辑(Map -> Shuffle -> Reduce)。

- 缺点:

- 单机限制:无法利用多台机器的分布式计算能力。

- 简化:Shuffle & Sort 过程使用简单的哈希表和内存存储,无法处理比内存大的数据集。

- 手动实现:开发者需要手动处理数据分区、排序、聚合等逻辑,容易出错,且代码复杂。

使用 Hadoop MapReduce 框架(C/C++)

在生产环境中,当需要处理 TB 级甚至 PB 级的数据时,我们必须使用像 Hadoop 或 Spark 这样的分布式框架。

Hadoop MapReduce 与 C/C++

Hadoop MapReduce 框架本身是用 Java 编写的,它通过 JNI (Java Native Interface) 机制来支持 C/C++ 编写的 Mapper 和 Reducer。

工作流程

- 编写 C/C++ 代码:用户需要编写两个 C/C++ 函数,一个

map函数和一个reduce函数。 - 编译为共享库 (Shared Library):将这些 C/C++ 代码编译成一个

.so(Linux) 或.dll(Windows) 文件。 - 配置 Hadoop Job:在 Java 代码中配置 Hadoop Job 时,指定这个共享库的路径,并告诉 Hadoop 使用哪个 C/C++ 函数作为 Mapper 和 Reducer。

- 执行:Hadoop 框架在启动 Task 时,会加载这个共享库,并在 JVM 中调用你定义的 C/C++ 函数。

示例概述(单词计数)

由于这个过程比较复杂,涉及 Java 和 C 的交互,这里只概述步骤,不提供完整代码。

-

C/C++ 代码 (

wordcount_mapper.c,wordcount_reducer.c)- Mapper: 读取标准输入(Hadoop 会将数据块喂给它),按行分割单词,然后将每个单词和

1输出到标准输出。 - Reducer: 读取标准输入(格式为

word\t1\t1\t1...),对同一个word的所有1进行求和,然后将word和总和输出到标准输出。

// wordcount_mapper.c (简化版) #include <stdio.h> #include <string.h> #include <stdlib.h> int main() { char line[1024]; while (fgets(line, sizeof(line), stdin)) { char *token = strtok(line, " \t\n"); while (token != NULL) { printf("%s\t1\n", token); token = strtok(NULL, " \t\n"); } } return 0; } - Mapper: 读取标准输入(Hadoop 会将数据块喂给它),按行分割单词,然后将每个单词和

-

编译

# 编译 Mapper gcc -shared -fpic -o libmapper.so wordcount_mapper.c # 编译 Reducer gcc -shared -fpic -o libreducer.so wordcount_reducer.c

-

Java 代码 (Hadoop Driver)

-

你需要编写一个 Java 程序来配置 Hadoop Job。

-

在

Job的配置中,设置NativeLibrary的路径:// 在你的 Java Driver 代码中 Configuration conf = new Configuration(); // 设置 C/C++ 共享库的路径(可以是 HDFS 路径或本地路径) conf.set("mapreduce.job.map.class.path", "/path/to/libmapper.so"); conf.set("mapreduce.job.reduce.class.path", "/path/to/libreducer.so"); // 设置 Mapper 和 Reducer 的类名(可以是任意占位符,框架会通过 JNI 调用) // 实际的调用方式取决于 Hadoop 版本和配置,可能更复杂 job.setJarByClass(YourDriverClass.class); job.setMapperClass( ... ); // 可能需要继承一个特定的 Native 类 job.setReducerClass( ... ); -

注意:Hadoop 对 C/C++ 的支持并非其核心功能,配置相对繁琐,且性能可能不如 Java 版本(因为 JNI 调用有开销),官方文档和社区支持也相对较少。

-

优缺点

- 优点:

- 分布式处理:可以处理海量数据,横跨成百上千台服务器。

- 容错性:框架会自动处理任务失败、节点故障等问题。

- 缺点:

- 复杂性高:需要同时掌握 Java、C/C++、Hadoop 和 JNI,开发和调试非常困难。

- 性能开销:JNI 调用会带来额外的性能开销。

- 非主流:Hadoop 生态中最主流、最成熟的开发语言是 Java 和 Python,使用 C/C++ 通常是为了复用现有的高性能库。

总结与建议

| 特性 | 单机 C 实现 | Hadoop C/C++ 实现 |

|---|---|---|

| 适用场景 | 学习、小规模数据处理、单机高性能计算 | 大规模分布式数据处理 |

| 依赖 | 无 | Hadoop 集群、JNI |

| 易用性 | 较高,逻辑清晰 | 非常低,配置复杂,调试困难 |

| 性能 | 受限于单机内存和 CPU | 可扩展至集群,但 JNI 有开销 |

| 核心价值 | 理解 MapReduce 思想 | 利用现有 C/C++ 代码库处理大数据 |

给你的建议:

- 如果你是初学者,想学习 MapReduce 的原理:从情况一(单机 C 实现)开始,手动实现一遍,会让你对 MapReduce 的三个阶段有非常深刻的理解。

- 如果你是开发者,需要在生产环境中用 C/C++ 处理大数据:可以考虑使用 Hadoop 的 C/C++ 接口,但要做好应对复杂性的准备,一个更现代的选择是使用 Apache Spark,它对 Python 和 Scala 的支持非常好,并且可以通过 PySpark 调用 C 扩展,生态更活跃。

- 如果你的主要目标是高性能计算:MapReduce 并非唯一选择,可以考虑使用 MPI (Message Passing Interface) 进行更底层的并行计算,或者使用 OpenMP 进行共享内存并行,这些在科学计算领域更为常用。